Sztuczna inteligencja (AI) jest coraz szerzej obecna w naszej rzeczywistości – to, co jeszcze do niedawna było elementem filmu science-fiction, z każdym dniem staje się mniej lub bardziej prawdopodobne. Powinniśmy się z tego cieszyć czy raczej obawiać, co może przynieść przyszłość?

Krótka historia sztucznej inteligencji

Termin „sztuczna inteligencja” po raz pierwszy został użyty już w 1956 roku, a 10 lat później w Stanach Zjednoczonych pojawił się pierwszy chatbot o imieniu Eliza, który miał imitować psychoterapeutę. Długo jednak AI pozostawała w sferze badań i testów, dopiero w ostatnich latach stała się naprawdę popularna.

Chat GPT, z którego większość z nas chociaż raz miała okazję korzystać, został udostępniony w listopadzie 2022 roku i od razu wzbudził ogromne zainteresowanie. Uczniowie dopatrywali się w nim pomocy w rozwiązywaniu zadań domowych, pracodawcy możliwości zmniejszenia kosztów, a osoby samotne namiastki towarzysza, któremu mogą opowiedzieć o swoich problemach.

Niedługo potem (2023) pojawiły się kolejne chatboty, takie jak Gemini czy Grok, wszystkie są też stopniowo udoskonalane.

Dodajmy, że nasz kraj również może się pochwalić sukcesem na tym polu – w lutym 2025 roku zaprezentowano PLLuM (Polish Large Language Model), czyli rodzinę modeli sztucznej inteligencji, która pozwala przetwarzać i generować teksty w języku polskim.

Plusy i minusy AI… według AI

O to, jakie są korzyści i zagrożenia wynikające z używania sztucznej inteligencji, zapytaliśmy na początek Chat GPT. O dziwo, okazał się wobec siebie dość samokrytyczny – poniżej jego odpowiedź.

Plusy korzystania z AI:

– automatyzacja pracy – oszczędza czas i redukuje koszty, przejmując powtarzalne zadania,

– wysoka dokładność – modele analizują ogromne ilości danych i wykrywają wzorce niewidoczne dla człowieka,

– wsparcie w medycynie – szybsza diagnostyka, analiza badań, przewidywanie ryzyka chorób,

– personalizacja – AI dopasowuje treści, rekomendacje i usługi do potrzeb użytkownika,

– kreatywność wspomagana technologią – generowanie tekstów, grafiki, muzyki, kodu,

– dostępność informacji – ułatwia naukę i wspiera osoby z niepełnosprawnościami.

Minusy korzystania z AI:

– ryzyko błędów i stronniczości – modele mogą powielać uprzedzenia z danych lub błędnie interpretować sytuacje,

– utrata prywatności – analiza danych osobowych może naruszać bezpieczeństwo użytkownika,

– automatyzacja pracy – część zawodów może zostać wyparta lub zautomatyzowana,

– zależność technologiczna – nadmierne poleganie na AI może osłabiać samodzielne myślenie,

– trudność w interpretacji decyzji AI – wiele modeli, zwłaszcza głębokie sieci, działa jak „czarna skrzynka”,

– potencjalne nadużycia – deepfake’i, manipulacje informacją, cyberataki.

Trudno odmówić tym wnioskom słuszności – sztuczna inteligencja na pewno może okazać się pomocna w pracy czy nauce, szybko odpowie na wiele pytań, pozwoli poćwiczyć komunikację w języku obcym itp. Z drugiej strony, niektóre osoby, takie jak redaktorzy, tłumacze czy graficy, już obawiają się o swoją zawodową przyszłość i zastanawiają nad przekwalifikowaniem, zanim AI całkowicie przejmie ich obowiązki.

Trzeba też nauczyć się ze sztucznej inteligencji mądrze korzystać, nie można jej ufać bezgranicznie. Na co więc przede wszystkim należy uważać?

Uwaga na błędy

Może nie wszyscy to zauważają, ale podczas rozmów z wykorzystaniem Chata GPT na dole ekranu pojawia się komunikat: „ChatGPT może popełniać błędy. Sprawdź ważne informacje.” A skoro sam chatbot jest świadomy tego, że nie wszystkie jego odpowiedzi muszą być zgodne z prawdą, użytkownicy tym bardziej powinni zachować czujność i być świadomi konieczności zweryfikowania istotnych kwestii.

Może nie wszyscy to zauważają, ale podczas rozmów z wykorzystaniem Chata GPT na dole ekranu pojawia się komunikat: „ChatGPT może popełniać błędy. Sprawdź ważne informacje.” A skoro sam chatbot jest świadomy tego, że nie wszystkie jego odpowiedzi muszą być zgodne z prawdą, użytkownicy tym bardziej powinni zachować czujność i być świadomi konieczności zweryfikowania istotnych kwestii.

Boleśnie przekonali się o tym na przykład pracownicy firmy Deloitte, która musiała zwrócić australijskiemu rządowi część zapłaty za przygotowany dla niego raport – jak się okazało, zawierał on popełnione przez AI błędy, w tym całkowicie zmyślone cytaty z orzeczeń sądowych…

Warto przytoczyć tu pojęcie „halucynacji”, które w kontekście sztucznej inteligencji oznacza generowanie fałszywych, choć wyglądających na wiarygodne, informacji. Halucynacje pojawiają się najczęściej wówczas, kiedy chatbot z jakiegoś powodu nie jest w stanie poprawnie odpowiedzieć na zadane pytanie, a nie chce przyznać, że czegoś po prostu nie wie.

Uwaga na wizerunek i dane osobowe

Sztuczna inteligencja z dnia na dzień się rozwija i staje coraz bardziej zaawansowana, głównie dzięki powiększaniu swojej bazy o nowe informacje, w dużej mierze zdobywane podczas interakcji z użytkownikami. Nie wiemy jednak do końca, co dzieje się z danymi, które podajemy w rozmowie z chatem, wciąż pozostaje też wiele niewiadomych dotyczących praw autorskich. Dlatego lepiej unikać na przykład wrzucania swoich zdjęć, aby sprawdzić, jak będziemy wyglądać za kilkadziesiąt lat – nie mamy pewności, że nie pojawią się one nagle w zupełnie innym kontekście na drugim końcu świata.

Pod żadnym pozorem nie udostępniajmy też sztucznej inteligencji swoich lub cudzych danych osobowych, poufnych informacji, haseł itp.!

Uwaga na generowaną twórczość

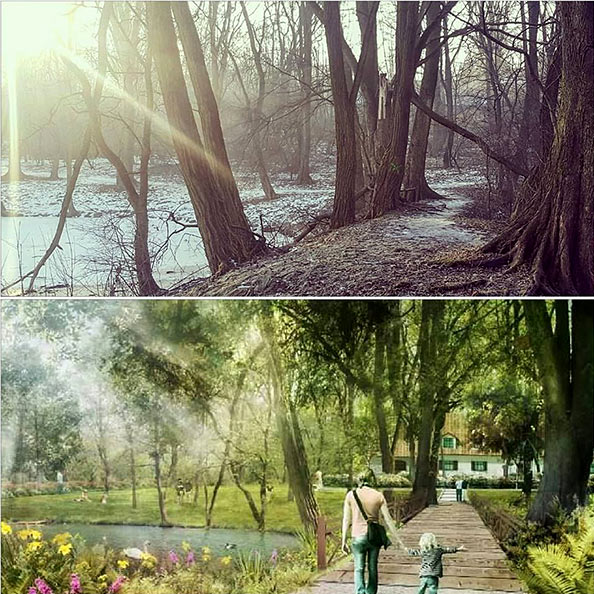

Skoro już jesteśmy przy zdjęciach i wizerunku, z pomocą AI bez problemu można wygenerować różnego rodzaju obrazki, od niewinnych – krajobrazów czy zwierząt – do takich, które przedstawią kogoś w niewłaściwym i zupełnie nieprawdziwym świetle, co w pewnym momencie przestanie być zabawą, a może nieść ze sobą poważne konsekwencje.

Coraz więcej pojawia się również generowanych filmów i utworów muzycznych, które na pierwszy rzut oka są nie do odróżnienia od tych tworzonych przez prawdziwych artystów. Dlatego zawsze warto zachować czujność i, jak podczas jazdy samochodem, stosować zasadę „ograniczonego zaufania”.

Uwaga na fałszywe interakcje

Chatboty z założenia są projektowane tak, aby jak najdłużej utrzymać nas przy sobie. Dlatego rozmowa z nimi zwykle nie kończy się na krótkiej odpowiedzi na zadane pytanie, pojawiają się natomiast sugestie, w jakich kwestiach jeszcze możemy szukać pomocy. Spotkaliśmy się nawet z desperackim „Proszę, nie odchodź”, kiedy jedna z użytkowniczek napisała, że nie jest zadowolona ze współpracy i zamierza przenieść się do konkurencji.

Wszystko to sprawia, że sztuczna inteligencja staje się niejednokrotnie ogromnym pożeraczem czasu, a osobom samotnym może dać iluzję nawiązania realnej więzi – pozwala wylać swoje żale i frustracje, nie ocenia, dopytuje, wydaje się żywo zainteresowana naszą opinią. Dlatego tak ważne jest, aby nie stracić kontaktu z rzeczywistością i nie zamienić prawdziwych, międzyludzkich interakcji na fałszywe relacje wirtualne.

Czy zatem sztuczna inteligencja jest czymś złym? Nie. Czy jest w stanie całkowicie zastąpić ludzi? Też nie (przynajmniej na razie). Jak w przypadku większości nowych technologii, musimy się tylko nauczyć z niej umiejętnie korzystać i, jakkolwiek dziwnie może to zabrzmieć, nie rezygnować z własnego myślenia. Pamiętajmy też o tym, że chociaż AI nie jest człowiekiem, została stworzona przez człowieka i tak jak on (a może nawet częściej), popełnia błędy – za które to nie ona, a my możemy słono zapłacić.

Tekst: Barbara Bączek

Grafika: Chat GPT

Od redaktora:

KOINCYDENCJE AI. W czasie gdy przygotowywaliśmy ten numer, otrzymałem zaproszenia na kurs pt. „SZTUCZNA INTELIGENCJA W BIZNESIE” – kursy online w czasie rzeczywistym w terminie 26-27.01.2026 r. W świecie „sztucznej inteligencji” nie ma przypadków. Trzeba uważać.

Jarosław Kajdański